最近的deepseek-R1模型很火,我也去尝试了一下,确实挺强大的。奈何实在太火了,官方服务器不堪重负,一直会出现“服务器繁忙,请稍后再试”!!!实在无法忍受了,只能另辟蹊径。

由于本地电脑配置不是很高,如果采用本地部署模型的话可能体验会更差。国内其他大厂提供了API接口,可以使用API接口来部署,本文章将详细记录通过在nas上通过百度千帆的API部署DeepSeek-V3 DeepSeek-R1。目前百度的DeepSeek-V3 DeepSeek-R1还处于免费阶段,此文章也适用deepseek官方api。

本次教程使用的nas是极空间Z4Pro,需要用到docker服务,其余nas平台都大同小异,可以作为参照。

1. 安装lobe-chat

1.1 下载镜像

打开及空间Docker服务,在设置中开启Docker服务

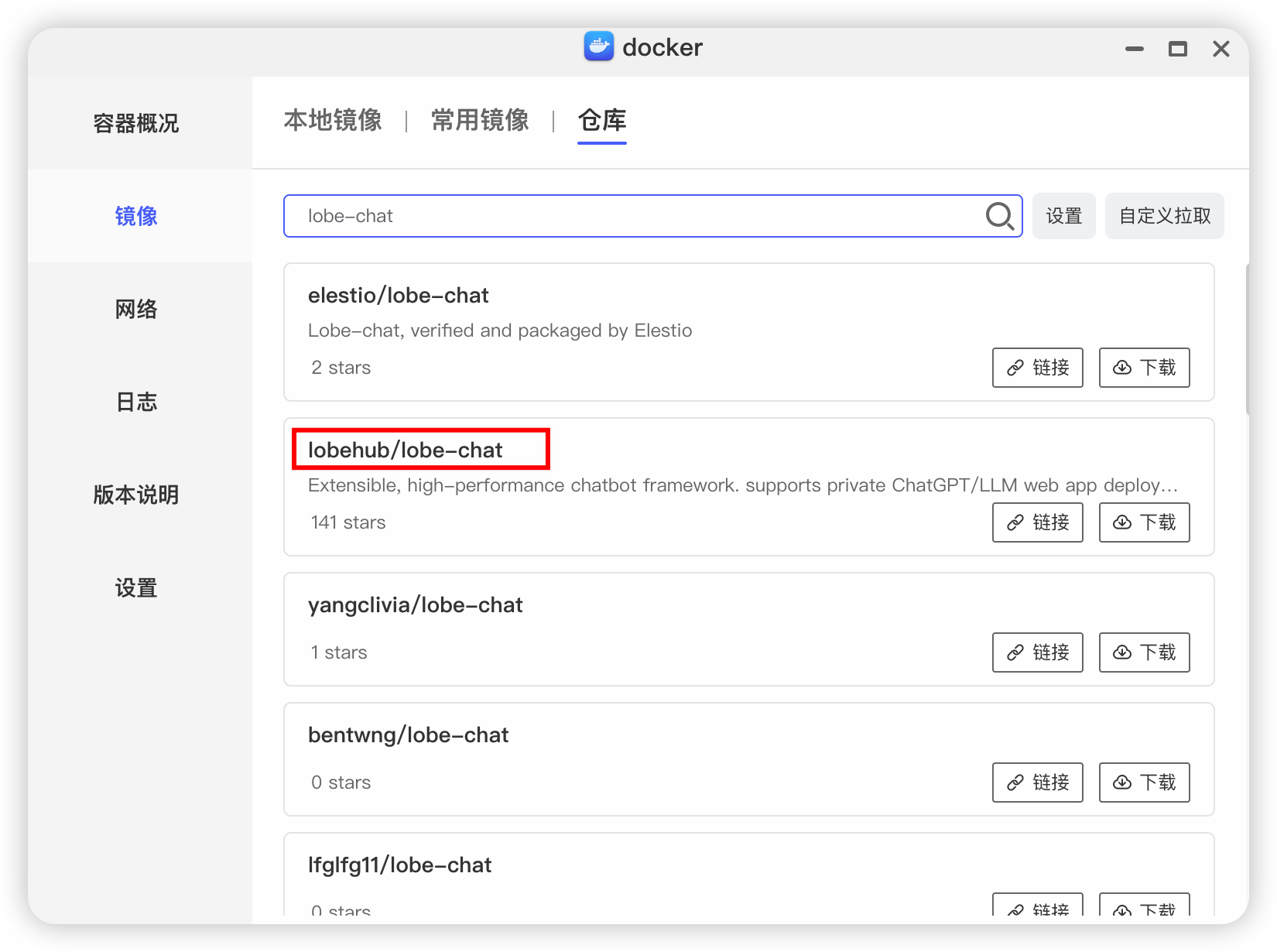

之后再依次点击:镜像>仓库;在搜索栏中输入lobe-chat后搜索(注:此处应当已经设置好网络代理,否则将无法正常搜索下载,若未设置网络可直接跳过此步,可至文章末尾我将留下镜像文件下载地址及导入方式方便下载使用)

找到lobehun/lobe-chat后点击下载稍等片刻

1.2 创建容器

下载完成镜像后在 镜像>本地镜像中找到刚刚下载的镜像,点击添加到容器

a.基本设置:可以保持默认

b.文件夹路径:点击添加,在nas存储空间中新建一个文件夹用以存储数据,比如 Docker/lobe-chat,装载路径 /data

c.网络:保持默认即可

d.端口:本地端口设置一个容易记的,此处我保持跟容器端口一致 3210,容器端口保持默认

e.其余设置保持默认,点击应用

至此,lobe-chat就已经安装完成

2. 获取deepseek模型的API key

2.1 获取百度API key

注:使用百度api跟官方api均可,目前官方api负载太大容易卡顿,此处选择百度提供的api

打开百度千帆官网,注册账号;地址:https://cloud.baidu.com/product-s/qianfan_home

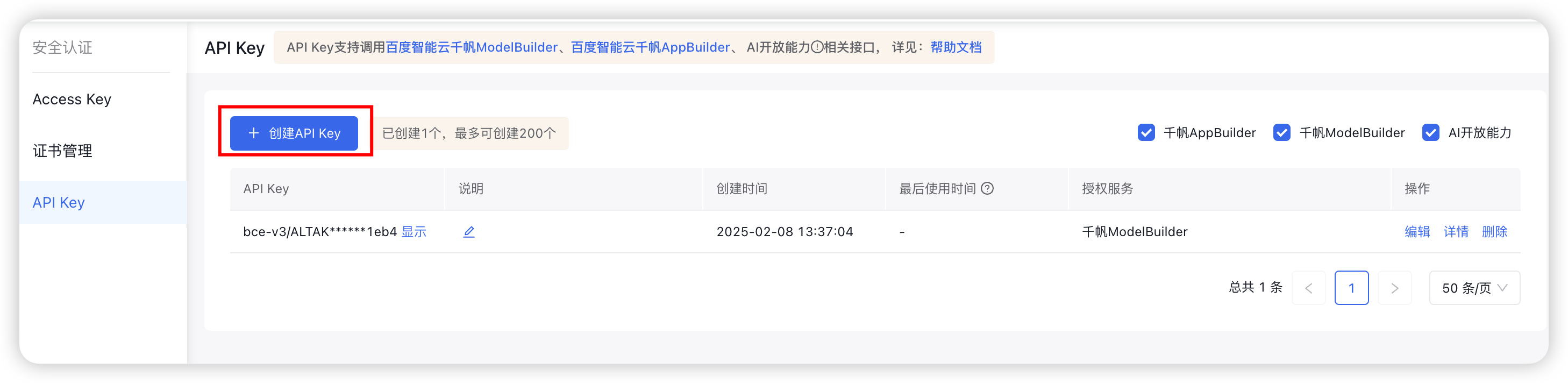

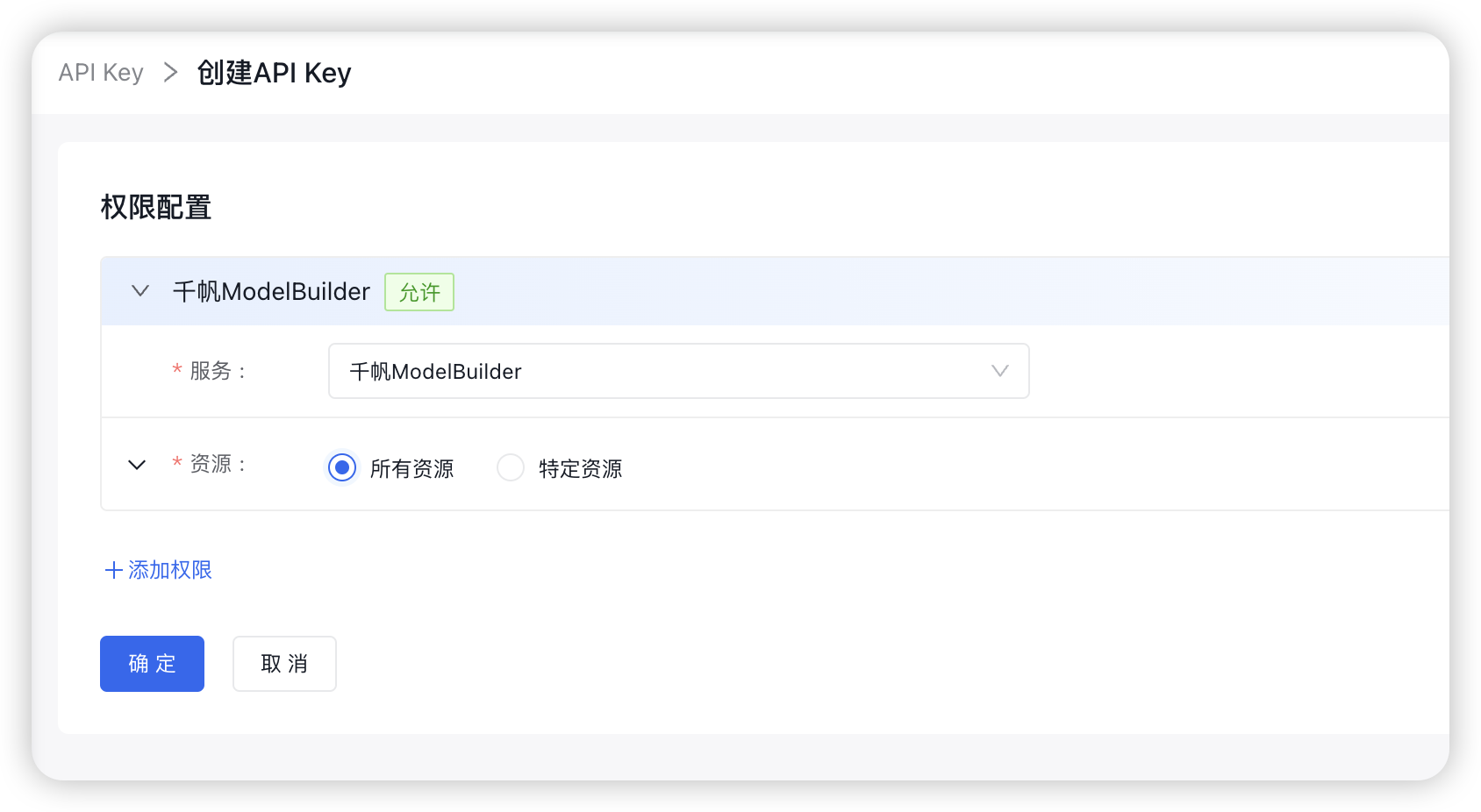

打开控制台,点击API-key管理;创建API key;地址:https://console.bce.baidu.com/iam/#/iam/apikey/list

设置完成后直接点击确定;创建完成后复制API key备用

过程中可能会需要实名认证,根据提示操作即可;

注:目前deepseek处于免费阶段,后期应该会收费,需要关注收费情况,以免系统自动扣费造成损失,可至控制台查看,地址:https://console.bce.baidu.com/#/index/overview

2.2 获取官方API key

3. deepseek部署

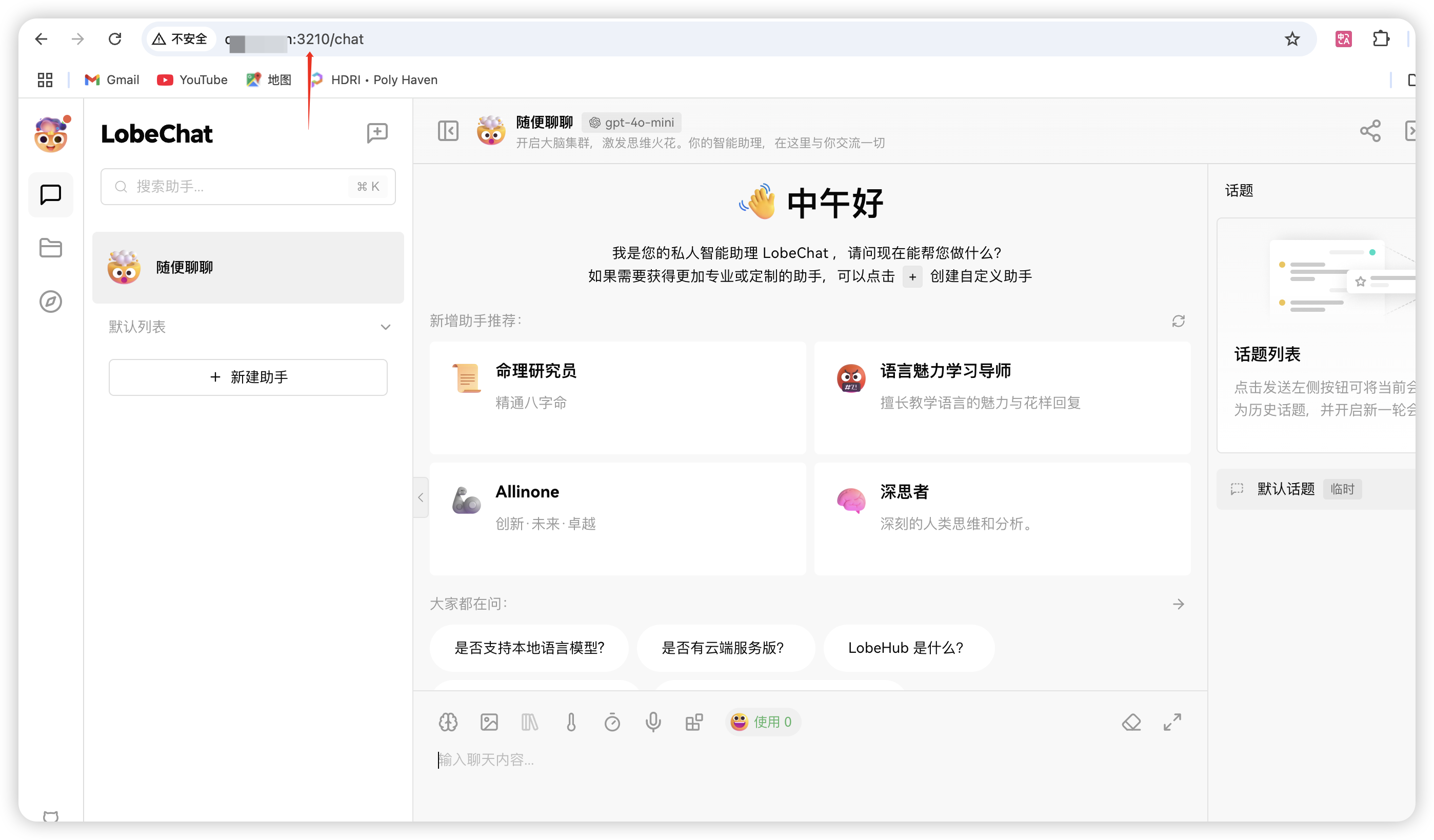

使用跟nas在同一局域网中的电脑浏览器登录lobe-chat,在浏览器地址中输入nas局域网ip地址加端口号即可访问;例如”192.168.2.xxx:3210“

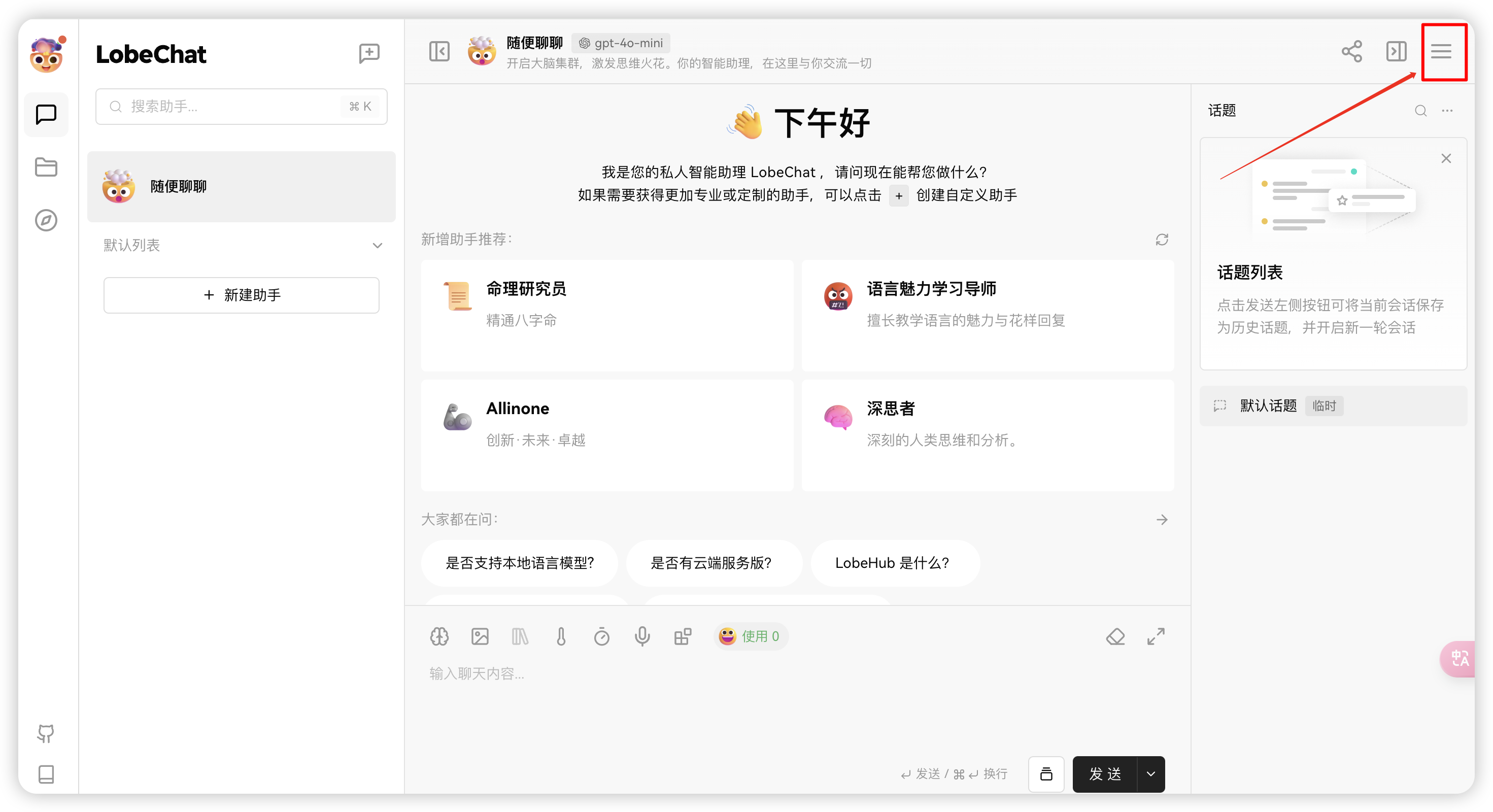

点击右上角设置按钮

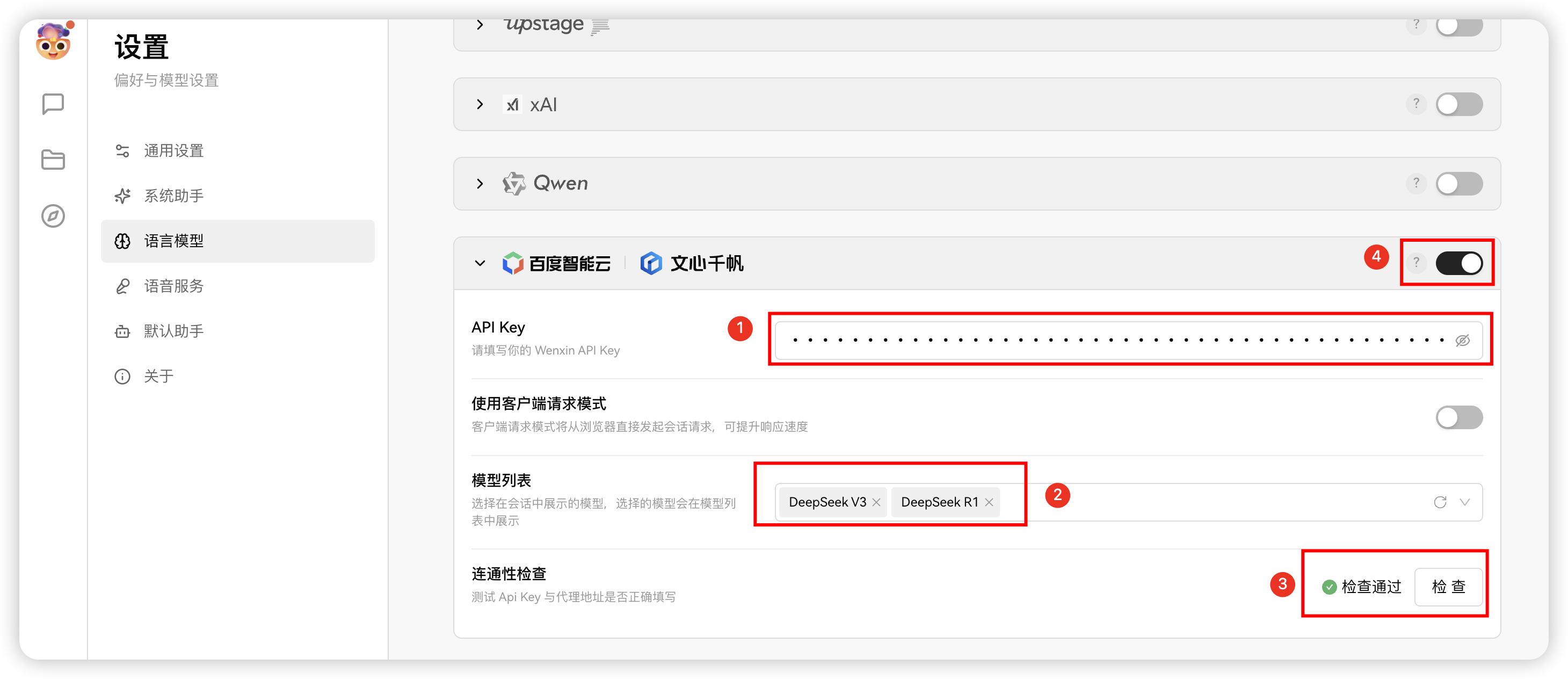

在设置中选择语言模型,找到百度文心千帆

a.在API key栏中填入刚刚申请的key

b.在模型列表中选择deepseek的两个模型

c.点击检查确认检查通过

d.打开右上角按钮

4.测试

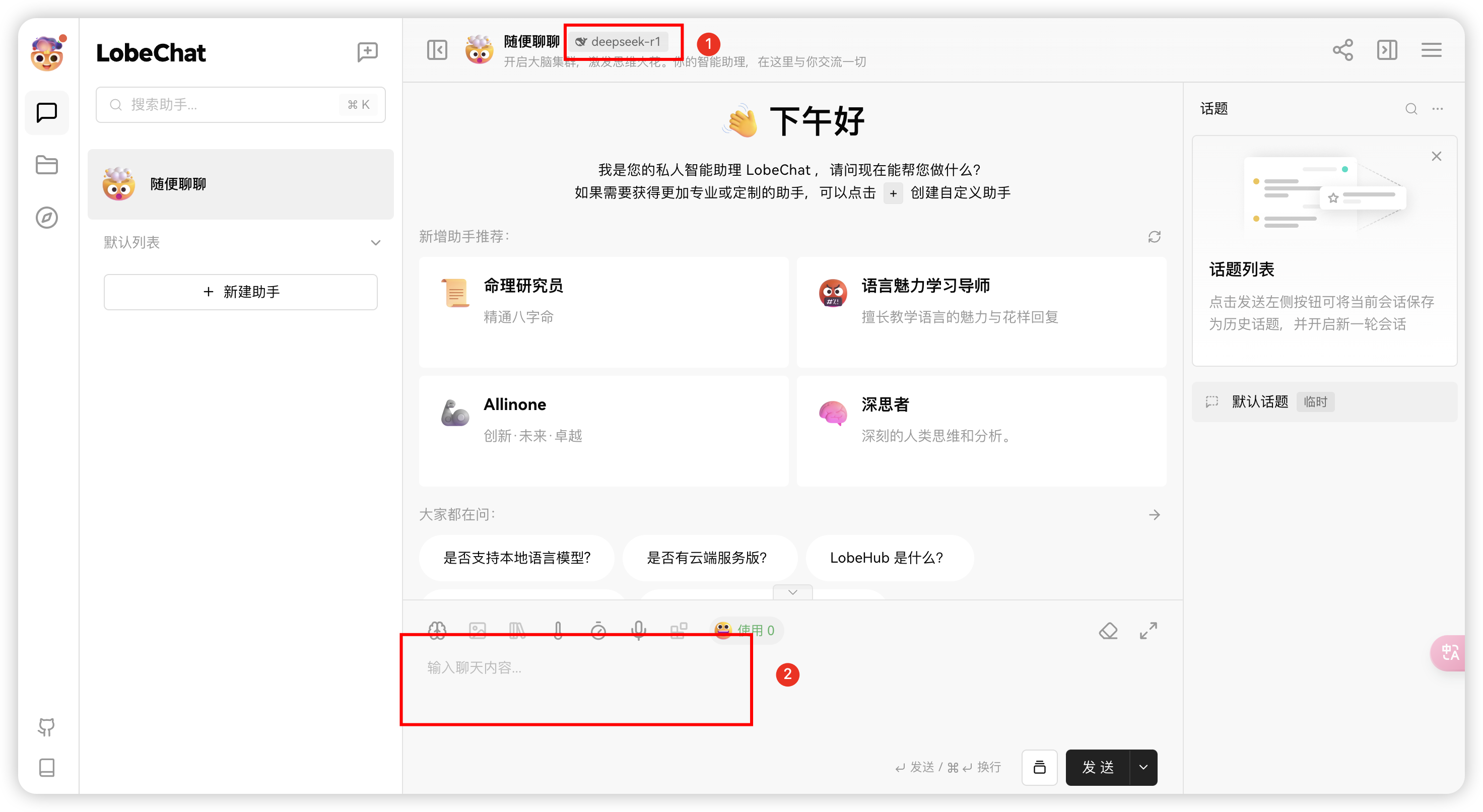

在会话页面中,点击上方选择模型按钮选择deepseek-r1模型,就可以快乐的使用了,目前测试基本没什么卡顿

至此,整个教程就结束了,目前只能在局域网中使用,如果需要在公网使用,需要通过公网ip或者通过内网穿透工具将其映射到公网,或者如果有云服务器也可以使用云服务器部署更方便,过程大同小异。

5. 补充

5.1 lobe-chat镜像文件下载地址

通过百度网盘分享的文件:lobehub_lobe-chat_latest.tar

链接:https://pan.baidu.com/s/1s1COaNqJSmKdwU2UuacUKA

提取码:fyus

5.2 导入镜像

将下载好的镜像文件上传到极空间;在本地镜像中选择导入镜像>从极空间导入,选择镜像导入即可

导入完成后可直接跳到1.2小节

5.3 使用客户端部署

如果只是想在某一台设备上部署,可以直接使用开源chat工具,比如cherry-studio、nextChat等,部署过程基本与第3小节相似

客户端下载地址:

cherry-studio: https://cherry-ai.com/

nextChat:https://github.com/ChatGPTNextWeb/NextChat